Deepfake 人工智能「換臉」技術已經不是新鮮事,不過隨着技術越來越技術,要做到這個效果的門檻變得更低,除了色情影片之外,如果有圖謀不軌的人利用 Deepfake 製作假新聞加以傳播,則可以有效操控輿論。美國國會最近就針對這個危機進行討論,尋求解決辦法。

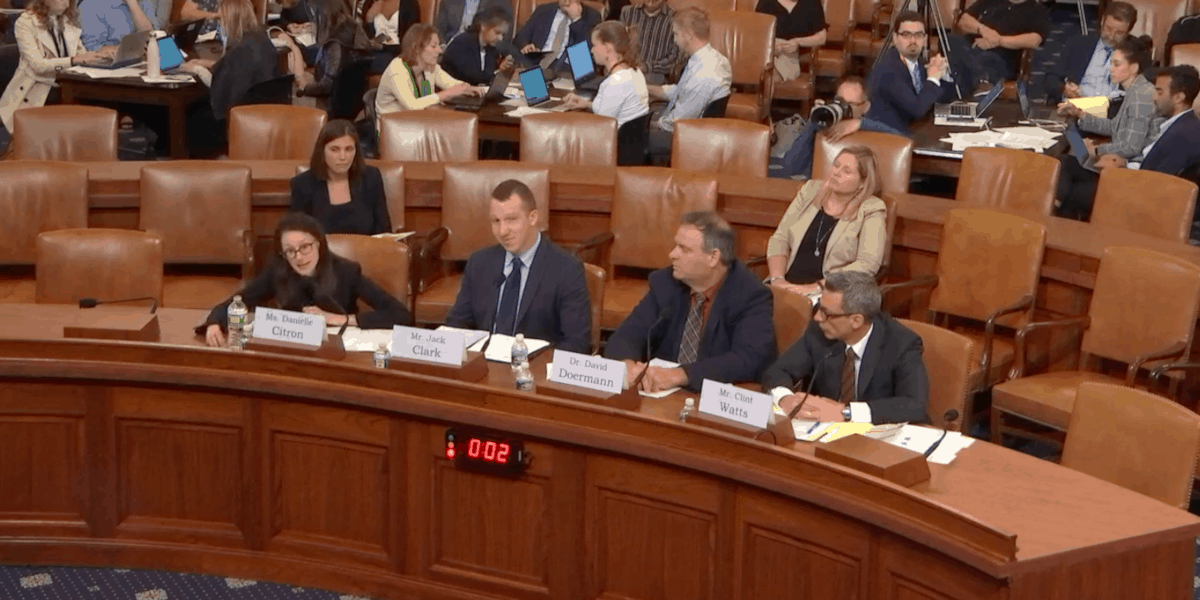

美國國會的情報委員會最近開會與 AI 專家討論 Deepfake 技術的對應方式,這個問題如果不作處理,到明年即將舉行的美國總統大選,就有機會被利用作為操控輿論的工具,令選民暴露於虛假資訊之中。上次美國總統大選曾經出現外國大規模操控輿論的情況,因此今次亦需要嚴防類似的事情發生。長遠而言這樣也會導致資訊不被信任。外交政策研究所研究員 Clint Watts 告訴委員會,如果一個資訊消費者不知道該相信什麼,他們不能從虛構內容中得知事實,那麼他們可能相信一切,或者根本不相信任何東西。如果他們什麼都不相信,那就會導致長期冷漠,這對美國具有破壞性。」

目前在各個範疇中已經開展研究工作以打擊 Deepfake。人工智能研究所所長 David Doermann 博士為去年 DARPA 媒體取證團隊的負責人,他和研究人員開始透過追蹤不規則眼球運動和 Allen Institute for Artificial Intelligence 合作使用深度檢測算法 Grover 來偵測 Deepfake 的 AI 系統,聲稱準確率達到 92%。委員會呼籲科技公司應該致力探索在資訊平台信阻止 Deepfake 內容流通的方法,而競選團隊亦不應使用這技術作宣傳,未來他們將考慮更多主動式預防,希望可以防範未然。

來源:Venture Beat