Facebook 演算法時有更改,每每令用戶怨聲載道,Facebook 亦非完全絕緣,知道外界對其演算法及相關行動的批評聲音,故此日前就推出針對用戶的使用習慣及演算法的研究報告;但就反被指報告只志在澄清演算法的負面影響及研究取樣方式不當等情況,令事件越描越黑。

研究取樣率低、參考價值成疑

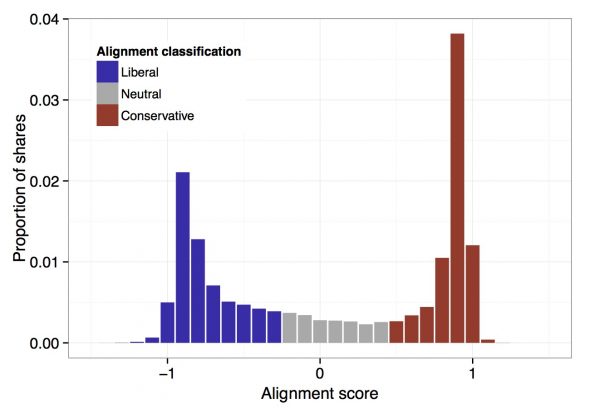

Facebook 的資料科學研究團隊由去年七月開始起進行為期六個月的研究,研究針對有在其個人資料中填寫政治傾向的美國 Facebook 用戶進行;團隊認為研究結果反映用戶的個人選擇遠高於演算法對貼文出現率所造成的影響。

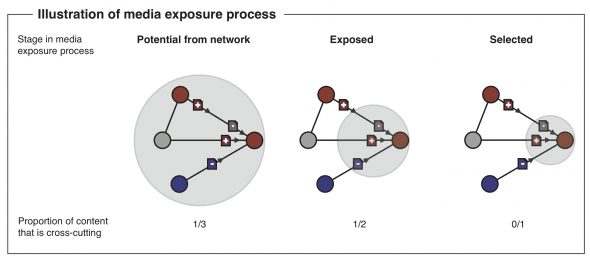

因為雖然演算法確會令用戶有興趣的貼文出現率較高,但其他貼文亦非完全絕跡:例如對支持保守派的美國 Facebook 用戶而言,儘管演算法會減少 8% 保守派相關的貼文出現,但因用戶在 Facebook 上的活動行為就令機率大升到 17%。Facebook 團隊由此推論用戶行為的實際影響遠較 Facebook 演算法來得大。

而儘管 Facebook 研究團隊指在全美的用戶數量達 1,010 萬,但由於研究團隊需遵守各種嚴格條件,令實際能夠於研究被用作統計樣本的用戶數量遠低於上述數字。

除研究在用戶數量方面的取樣為人詬病外,以於 Facebook 上作政治表態的用戶數據代表美國實際整體情況,亦未見準確。

大學教授 Eszter Hargittai 亦就 Science 竟容許此等鬆散報告刊登作出批評,並指報告明顯地無法推論到實際的美國用戶情況,更何況演算法對全球 Facebook 用戶的影響。Hargittai 續指,研究重點之一的取樣方式竟只提供於補充資料,缺席於報告中,容易於現解論文時出現解讀錯誤的情況。

Source:Research at Facebook